تكنولوجيا وأمن معلومات

الهندسة العكسية للذكاء الاصطناعي: استكشاف نقاط الضعف واستراتيجيات التخفيف

علي أبو الحسن

يُعد الذكاء الاصطناعي ثورة حقيقية في مختلف المجالات، بدءًا من الطب والهندسة إلى الأعمال والترفيه. مع ذلك، فإن هذه الثورة تأتي مع بعض المخاطر، أهمها إمكانية استغلال تقنيات الذكاء الاصطناعي لأغراض خبيثة وذلك من خلال مجموعة من الأساليب ومنها الهندسة العكسية.

فالهندسة العكسية في الذكاء الاصطناعي (1) هو مجال يجمع بين التقنيات المتقدمة والأفكار الابتكارية لفهم وتعديل أنظمة الذكاء الاصطناعي الموجودة، لذلك سنتناول في هذا المقال مفهوم الهندسة العكسية، تاريخها، نقاط الضعف في الذكاء الاصطناعي، استراتيجيات التخفيف، وأمثلة على المخاطر المرتبطة بها.

إذن الهندسة العكسية في مجال الذكاء الاصطناعي تعنى عملية تحليل البرمجيات والأنظمة من قبل المهندسين، الباحثين، وخبراء الأمن لفهم عملها من دون الحصول على الكود المصدري لهذه الأنظمة، وهذا يشمل تحليل النماذج الذكية لاكتشاف كيفية تدريبها واستخلاص البيانات التي تم تدريبها عليها وصولًا لفهم العمليات الداخلية للخوارزميات، إذن الهندسة العكسية للذكاء الاصطناعي هي عملية تفكيك نظام ذكاء اصطناعي لفهم كيفية عمله، وبذلك فإنّ الهدف من استخدام الهندسة العكسية في الذكاء الاصطناعي تتضمن تحسين الأمان، اختبار الأداء، وإيجاد نقاط الضعف في هذه الأنظمة.

تقنيات الهندسة العكسية للذكاء الاصطناعي تطوّرت بشكل كبير عبر الزمن من الأساليب البدائية إلى استخدام الأدوات المعقّدة والآليات البرمجية المتطورة، ومن أهم الإنجازات في هذا المجال تطوير أدوات قادرة على تحليل وفهم الشبكات العصبية العميقة، ولكنها لا تزال تواجه بعض التحديات التي تشمل التعامل مع التعقيد المتزايد للأنظمة وحماية الملكية الفكرية.

وبشكل عام تواجه أنظمة الذكاء الاصطناعي مجموعة من نقاط الضعف منها:

التحيز في البيانات: البيانات المتحيزة يمكن أن تؤدي إلى نتائج غير عادلة وتشويهات في قرارات الذكاء الاصطناعي، إذ إنّ اكتشاف وتخفيف التحيز يتطلب استخدام أساليب التحليل الإحصائي والتدقيق الأخلاقي للبيانات.

الاختراقات الأمنية: أنظمة الذكاء الاصطناعي معرضة لأنواع مختلفة من الهجمات Adversarial Attacks، بما في ذلك تلك التي تستهدف البيانات أو النماذج نفسها، وإنّ تأمين هذه الأنظمة يتطلب استراتيجيات أمنية معقّدة ومتعددة الطبقات.

الاعتماد على البيانات غير الموثّقة: إنّ الاعتماد المفرط على هذه البيانات يمكن أن يجعل النظم غير مستقرة أو قابلة للتلاعب، وإنّ تقليل هذا الاعتماد يتطلب استخدام تقنيات تعلم الآلة التي تتطلب بيانات أقل أو استخدام بيانات مولدة اصطناعيًا.

فقدان السيطرة: هناك مخاطر محتملة لفقدان السيطرة على أنظمة الذكاء الاصطناعي، مما يتطلب تطوير آليات رقابة وتحكم فعالة لا تستبعد العنصر البشري في القرار الأخير.

ويمكن اعتماد بعض الاستراتيجيات للتخفيف من نقاط ضعف أنظمة الذكاء الاصطناعي منها:

اختبار البيانات: عبر اعتماد أفضل الممارسات لاختبار البيانات واستخدام أدوات تحليلية متقدمة يمكن أن يساعد في ضمان الجودة والنزاهة في هذه الأنظمة.

الأمن السيبراني: تطبيق أفضل الممارسات الأمنية واستخدام أدوات متخصصة لحماية أنظمة الذكاء الاصطناعي يعتبر ضروريًا للدفاع ضدّ الهجمات.

التشريعات والقوانين: تطوير وتطبيق التشريعات والقوانين لتنظيم استخدام الذكاء الاصطناعي يمكن أن يساعد في تخفيف المخاطر المرتبطة بالهندسة العكسية وغيرها من الممارسات.

الوعي العام: يجب نشر الوعي حول مخاطر وإمكانيات تقنيات الذكاء الاصطناعي.

فاعتماد هذه الاستراتجيات يمكن أن يؤدي للتخفيف من المخاطر التي تتعرض لها أنظمة الذكاء الاصطناعي ومن هذه المخاطر الهجمات الموجهة ضدّ أنظمة الذكاء الاصطناعي حيث يمكن أن تستغل نقاط الضعف المحدّدة للتأثير على الأداء أو سرقة البيانات، ومنها أيضًا التلاعب بالبيانات والذي يمكن أن يؤدي إلى نتائج مضللة وتأثيرات سلبية على قرارات الذكاء الاصطناعي، بالإضافة إلى سرقة الملكية الفكرية إذ إنه يمكن استخدام الهندسة العكسية لسرقة أسرار تقنية من أنظمة الذكاء الاصطناعي.

إذن الهندسة العكسية في مجال الذكاء الاصطناعي تقدم تحديات وفرصًا كبيرة ويمكن استخدامها لأغراض إيجابية وسلبية، فمن خلال فهم المخاطر وتطبيق استراتيجيات التخفيف المناسبة، يمكن للمنظمات تحسين أمان وفعالية أنظمتها الذكية، ومع استمرار تطوّر التقنيات، ستظل الحاجة إلى الابتكار في مجال الأمان والخصوصية قائمة لضمان استخدام آمن ومسؤول للذكاء الاصطناعي.

ــــــــــــــــــــــــــــــــــــــــــــــــــــــ

(1) https://www.linkedin.com/pulse/cybersecurity-alert-how-attackers-reverse-engineering-ai-algorithms

إقرأ المزيد في: تكنولوجيا وأمن معلومات

19/06/2024

التصنيع الذكي والثورة الصناعية الرابعة

التغطية الإخبارية

"إسحاق بريك": الأوهام التي يحاولون بيعها للجمهور "الإسرائيلي" بأننا سنسقط حماس في لحظة واحدة هي عملية احتيال كبيرة

"إسحاق بريك": كلّ يوم يمر في حرب "السيوف الحديدية" يعمّق عملية انهيار دولة "إسرائيل"

"إسحاق بريك": يجب أن نفهم جيدًا أنّ قتل قادة حماس وحزب الله لا يقودنا إلى النصر

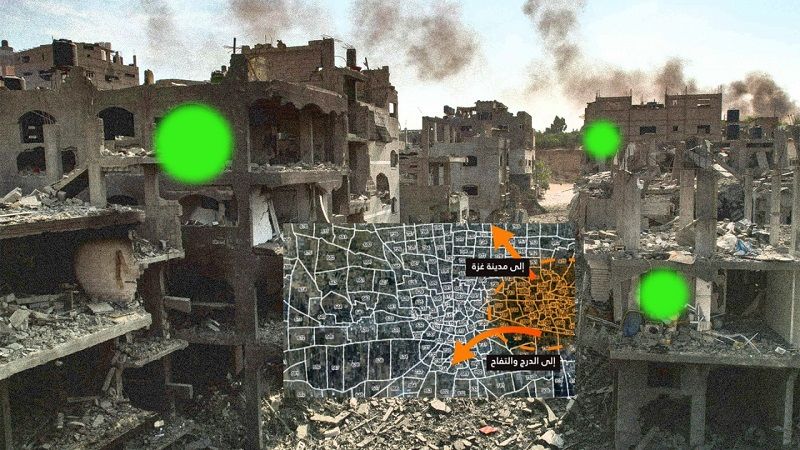

الجنرال "الإسرائيلي" المتقاعد إسحاق بريك: 80% من مئات الكيلومترات من أنفاق حماس لا تزال بتصرفها ويصل عدد المقاتلين إلى عشرات الآلاف

كتائب القسام: نتنياهو وسارة يحتفلان بعيد ميلاد ابنهما يائير على حساب الجنود في ميدان الحرب

مقالات مرتبطة

الشاشة الزرقاء: عطل تقني عالمي يعيد التفكير في أمان الحوسبة السحابية

التزييف العميق: الوجه المظلم للذكاء الاصطناعي وكيف نحمي أنفسنا منه

"هواوي" وهجومها العكسي على العقوبات الأميركية

هلوسات الذكاء الاصطناعي: الأسباب والأمثلة والحلول

التصنيع الذكي والثورة الصناعية الرابعة

البصمات الصوتية واستخدام الذكاء الاصطناعي في التعرف على الصوت

التفوق البشري في الذكاء الاصطناعي: كيف يختلف الذكاء الاصطناعي البشري عن التقليدي؟

أدوات التعلّم العميق والذكاء الاصطناعي